Ответы на вопросы по дисциплине «Прикладная эконометрика»

преподаватель – Черняк Владимир Ильич, 2010 год

ЧАСТЬ ПЕРВАЯ. ДО КОНТРОЛЬНОЙ.

ТЕМА 1. Метод наименьших квадратов. Свойства коэффициентов регрессии.

1. Что такое ковариация?

Ковариация – мера взаимосвязи между двумя переменными. Cov(x,y)=E[(x-μx)(y-μy)]. Ковариация в оценке силы связи между переменными не так полезна, как корреляция.

2. Что выражает ковариация переменных в регрессионной модели?

Зависимость или независимость переменных модели.

3. Каковы основные этапы построения и анализа регрессионной модели?

• Выдвижение рабочей гипотезы

• Построение модели

• Анализ качества и интерпретация модели

• Определение путей изменения модели

• Выдвижение новых гипотез и построение новых моделей.

• Практическое использование модели

4. В чем роль теоретической (гипотетической) регрессии в прикладном эконометрическом анализе?

Теоретическая (гипотетическая) регрессия позволяет производить теоретические расчеты (имеется в виду оценка последствий изменений значения какой-то объясняющей переменной), а также она используется для прогнозирования значений зависимой переменной.

Теоретическая регрессия:

Y=a+b*x+u, где u – случайный член

В регрессионном анализе изучается связь и

определяется количественная зависимость между зависимой переменной и одной или

несколькими независимыми переменными. Пусть переменная Y зависит от

одной переменной ![]() . При

этом предполагается, что переменная

. При

этом предполагается, что переменная ![]() принимает заданные фиксированные

значения, а зависимая переменна Y имеет случайный разброс из-за ошибок

измерения, влияния неучтенных факторов и т.д. Предположим, что Y в

"среднем" линейно зависит от значений переменной

принимает заданные фиксированные

значения, а зависимая переменна Y имеет случайный разброс из-за ошибок

измерения, влияния неучтенных факторов и т.д. Предположим, что Y в

"среднем" линейно зависит от значений переменной ![]() .

.

Таким образом, существуют наблюдаемые значения х и у, между ними предполагается линейная связь. Если бы соотношение между х и у было точно, то все наблюдаемые точки лежали на одной прямой Y=a+b*x. Однако истинные значения у отклоняются от этой прямой на величину случайного члена.

Таким образом, теоретическая регрессия необходима для оценки взаимосвязи между переменными. На основе n наблюдений строится расчетная регрессия, оцениваются коэффициенты а и b.

5. Почему расчетная регрессия не совпадает с теоретической?

Из-за наличия случайного члена невозможно рассчитать истинные значения b,α при попытке построить прямую и определить положение линии регрессии. т.к. остатки не совпадают со значениями случайного члена

6. В чем состоит разница между случайном членом

регрессии и остатками в регрессионном анализе?

Случайный член указывает на то, что существует случайная составляющая, которая влияет на зависимую переменную; остаток- измеренная величина отклонения между фактическим и расчетным значением переменной.

Случайный член (ui) включается в регрессию для подтверждения существования случайного фактора, оказывающего влияние на зависимую переменную. Yi=β1+β2Xi+ui

Остаток (ei) – измеримая разность между

действительной величиной Y в соответствующем наблюдении и расчетным

значением по регрессии. ei=Yi-![]()

7. В чем состоит идея метода наименьших квадратов?

Идея МНК основана на том, чтобы минимизировать сумму квадратов отклонений расчетных значений от эмпирических, т.е. нужно оценить параметры о функции f(a,x) таким образом, чтобы ошибки еi= уi-f(а,х), точнее - их квадраты, по совокупности были минимальными. Для этого нужно решить задачу минимизации суммы квадратов остатков S=e12+..+en2

8. В чем состоят основные достоинства и недостатки метода наименьших квадратов с точки зрения прикладной эконометрики?

Достоинства:

1. Наиболее простой метод выбора значений b1 и b2, чтобы остатки были минимальными;

2. При выполнении условий Гаусса-Маркова МНК-оценки будут наилучшими (наиболее эффективными) линейными (комбинации Yi) несмещёнными оценками параметров регрессии (b1 и b2).

Условия Гаусса-Маркова:

- модель линейна по параметрам и правильно специфицирована;

- объясняющая переменная в выборке имеет некоторую вариацию;

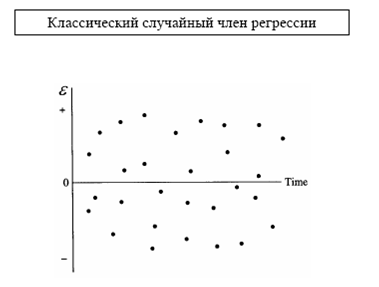

- математическое ожидание случайного члена равно нулю;

- случайный член гомоскедастичен;

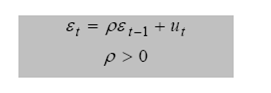

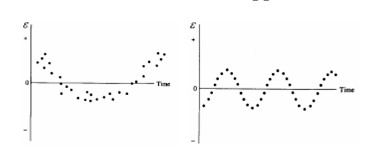

- значения случайного члена имеют взаимно независимые распределения;

- случайный член имеет нормальное распределение

Недостатки: МНК-оценки являются эффективными линейными несмещёнными ТОЛЬКО при выполнении ВСЕХ условий Гаусса-Маркова, что на практике встречается редко.

9. Как получить уравнения метода наименьших квадратов, используя производные?

y=a+bx; S2=∑(yi-a-bxi)2=> (S2)a’=0 и (S2)b’=0

10. Как выписать уравнения метода наименьших квадратов, не используя производные?

![]()

![]()

11. Пусть выборка состоит из трех точек (x1, y1), (x2, y2), (x3, y3). Как вывести уравнения метода наименьших квадратов, используя условия первого порядка для производных.

![]()

![]()

![]()

![]()

![]()

![]()

![]()

12. Как коэффициенты регрессии выражаются через основные статистические характеристики выборки (среднее, дисперсия, ковариацию и др.).

Вывод формул для оценки коэффициентов (для парной регрессии) в лекции 3.

![]()

![]()

13. Почему коэффициенты регрессии могут рассматриваться как случайные переменные? Каковы практические последствия этого факта?

Значения коэффициентов не могут быть точно предсказаны, находится их оценка (как частный случай). Коэффициент регрессии, вычисленный методом наименьших квадратов, - особая форма случайной величины, свойства которой зависят от свойств случайного члена в уравнении. Коэффициент регрессии, полученный по любой выборке, состоит из 2 слагаемых: 1) постоянной величины, равной истинному значению коэффициента, и 2) случайной составляющей, зависящей от случайного члена в выборке.

Последствия этого факта таковы, что возникает отклонение фактического значения от расчетного, в результате которого образуются остатки.

14. Что означает, что оценка коэффициента регрессии является несмещенной?

Математическое ожидание оценки равняется соответствующей характеристике генеральной совокупности.

15. Что означает, что оценка коэффициента регрессии является эффективной?

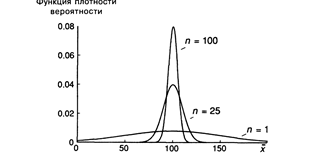

Она является надежной\точной с определенным уровнем значимости и чем он меньше, тем меньше вероятность ошибки (функция плотности вероятности распределения как можно более сжата вокруг истинного значения, т.е. дисперсия данной оценки минимальна). P-value низкий, что означает маленькую вероятность ошибки.

16. Что означает, что оценка коэффициента регрессии является состоятельной?

Это оценка, которая дает точное значение для большой выборки независимо от входящих в нее конкретных наблюдений, другими словами несет в себе меньшую среднеквадратичную ошибку.

17. Каковы свойства есть у остатков в парной регрессии? Запишите эти свойства в строгой математической форме?

eср=0, Cov(yоц.,e)=0, Var(ei)=const, Cov(ei,ej)=0. Свойства при МНК: ∑ei=0 и ∑Xiei=0

18. На какие компоненты раскладывается общая сумма квадратов остатков? В чем их смысл?

Общая сумма квадратов остатков (TSS) раскладывается на «объясненную» сумму квадратов (ESS) и остаточную («необъясненную») сумму квадратов (RSS).

TSS = ESS+ RSS

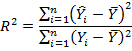

Подобное разложение позволяет оценить, на сколько хорошо выбранная модель (регрессия) объясняет поведение зависимой переменной. В частности, это используется при расчете коэффициента детерминации (R2). R2 показывает долю объясненной дисперсии зависимой переменной.

R2=ESS/TSS=1-RSS/TSS

19. Что такое коэффициент детерминации R2? Каков его смысл?

Коэффициент детерминации дает предварительную оценку качества модели и имеет значения в промежутке от 0 до 1. Он показывает долю объясненной дисперсии зависимой переменной (доля общей суммы квадратов, объясненной уравнением регрессии).

Если постоянный член включён в модель, то

разложение ![]() верно. Значит можно записать R2 следующим образом:

верно. Значит можно записать R2 следующим образом:

![]()

В иных случаях разложение неверно и уравнение расчёта R2 не эквивалентны.

R2=1, когда

линия регрессии точно соответствует всем наблюдениям, так что ![]() для всех наблюдений и все остатки

равны нулю. Можно сказать, что уравнение является идеальным. Если в выборке

отсутствует видимая связь между Y и

Х, то R2 будет близок к 0.

для всех наблюдений и все остатки

равны нулю. Можно сказать, что уравнение является идеальным. Если в выборке

отсутствует видимая связь между Y и

Х, то R2 будет близок к 0.

Коэффициент детерминации не позволяет дать окончательного заключения без учета других факторов, т.к. он подвержен влиянию посторонних факторов и может привести к ошибочному выводу. Даже если отсутствует зависимость между Y и Х, по любой данной выборке наблюдений может показаться, что такая зависимость существует, возможно, и слабая. Только по случайному стечению обстоятельств R2 в точности равен 0.

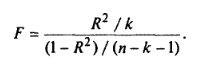

Однако таблицы для критических значений R2 отсутствуют, для этого нужно рассчитывать на его основе другие показатели. Например, F-критерий для проверки качества оценивания.

![]()

После вычисления F-критерия по значению коэффициента R2 отыскивается критический уровень F (Fкрит). Если F > Fкрит, то нулевая гипотеза (связь между Y и Х отсутствует) отклоняется и делается вывод, что имеющееся объяснение поведения Y лучше, чем можно было бы получить случайно.

Но возможен и расчет критического значения R2:

![]()

Если R2 > R2крит, то вывод об отклонении нулевой гипотезы подтверждается.

Согласие эмпирической прямой с данными, другими словами, показывает соответствие линии регрессии всем наблюдениям. Показывает наличие видимой/слабой связи между зависимой и объясняющими переменными, другими словами вклад переменной в модель. R2 показывает долю дисперсии зависимой переменной, “объясненной” (уравнением регрессии)

20. Какова связь коэффициента детерминации и коэффициента корреляции в парной

модели регрессии?

Чем больше R2, т.е., чем больше соответствие, обеспечиваемое уравнением регрессии, тем больше должен быть коэффициент корреляции для фактических и прогнозных значений у, и наоборот. R2 = коэффициент корреляции в квадрате.

21. Каковы пределы изменения коэффициента детерминации R2? Почему они такие?

0<R2<1, R2=1, когда уоц.=уi и все остатки равны 0 (Var(yоц.)=Var(y), Var(e)=0)

22. Почему метод наименьших квадратов эквивалентен задаче максимизации коэффициента детерминации R2?

![]() , а следовательно

, а следовательно ![]()

23. Какие практические выводы можно сделать из того факта, что коэффициент детерминации R2 оказался близок к единице?

1. Линия регрессии точно соответствует всем наблюдениям, отклонений нет

2. В оцениваемую модель не включили константу

3. Число объясняющих переменных равно (или близко) числу наблюдений

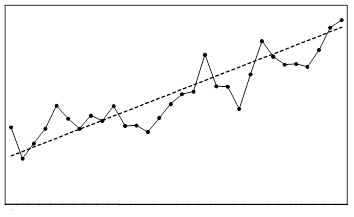

4. Сильная корреляция между переменными (нестационарность временных рядов)

24. Какие практические выводы можно сделать из того факта, что коэффициент

детерминации R2 оказался близок к нулю?

В выборке отсутствует видимая связь между зависимой и объясняющей переменной

25. Имеет ли смысл оценивать значимость уравнения регрессии с коэффициентом детерминации R2 близким к нулю?

Значимость оценивать целесообразно, т.к. даже столь маленькое значение R2 могло получиться не случайно, что нам покажет F тест. Маленькое же значение может говорить о невключении важных факторов. Также, даже при маленьком значении R2 мы можем сделать выводы о виде зависимости между независимым и зависимым показателем, т.е. растет ли Y при росте X или наоборот уменьшается. Это всегда полезно экономисту.

26. В чем состоят ограничения и недостатки практического использования коэффициента детерминации в R2 с точки зрения современных представлений о регрессионном анализе?

Недостатки:

R2 возрастает при добавлении нового регрессора;

R2 изменяется даже при простейшем преобразовании зависимой, поэтому сравнивать по значению R2 можно только регрессии с одинаковыми зависимыми переменными.

Низкое значение R2 не свидетельствует о низком качестве модели, и может объясняться наличием существенных факторов, не включенных в модель

27. Дает ли какую-либо

дополнительную информацию скорректированный коэффициент детерминации ![]() в парном регрессионном анализе?

в парном регрессионном анализе?

Ничего не даёт и не нужен (Черняк).

ТЕМА 2. Интерпретация и использование оценок коэффициентов регрессии в парной линейной регрессии.

28. Как интерпретируется коэффициент при независимой переменной в парной линейной регрессии? (короткая и развернутая форма интерпретации)

y = a + bx. Короткая интерпретация: b – величина, на которую в среднем изменяется значение переменной yi при увеличении независимой переменной x на единицу.

Развернутая: b –величина, на которую изменяется предсказанное по модели значение ŷi при увеличении значения независимой переменной x на одну единицу измерения.

29. Как интерпретируется коэффициент при переменной времени в парной линейной

регрессии? (короткая и развернутая форма интерпретации).

Коэффициент при переменной времени показывает, насколько в среднем изменится зависимая переменная при изменении времени на 1 период.

30. Как интерпретируется коэффициент при индексной переменной (например, при

индексе цен) в парной линейной регрессии? (короткая и развернутая форма

интерпретации)

Коэффициент выражает предельный прирост зависимой переменной при изменении переменной, при условии постоянства других переменных.

Увеличение индексной переменной на 1 процентный пункт приводит к изменению зависимой переменной на β единиц, при условии постоянства других переменных.

31. Как интерпретируется коэффициент при относительной индексной переменной (например, при индексе относительных цен) в парной линейной регрессии? (короткая и развернутая форма интерпретации)

Чем выше значение Индекса Цен, тем больше расходы на соответствующие товары.

Если относительная индексная переменная изменяется на 1 процентный пункт, то это приводит к изменению (в том же направлении) зависимой переменной на β единиц измерения зависимой переменной.

32. В чем смысл и каков способ расчета индекса относительных цен, используемого в эконометрических моделях?

Расчет индекса относительных цен позволяет избавиться от инфляции

Индекс относительных цен = индекс цен/ цена корзины потребительских товаров (индекс цен корзины).

33. Как интерпретируется константа в уравнении линейной регрессии с факторной независимой переменной?

Const дает прогнозируемое значение у (в единицах), если х=0.

Однако всегда важно учитывать смысловую интерпретацию.

34. Как интерпретируется константа в уравнении линейной регрессии с независимой переменной времени?

Константа имеет простое толкование, прогнозируемое значение у будет равно значению этой константы.

Если в качестве независимой переменной - время, то константа - это значение уравнение в предшествующий первому момент времени.

35. Каковы условия интерпретируемости константы в уравнении линейной регрессии?

Константу можно интерпретировать, когда она значима и когда это имеет экономический смысл. Второе условие выполняется для регрессий временного ряда (показывает значение зависимой переменной в базовый период).

Формально говоря, она показывает прогнозируемый уровень, когда х = 0. Иногда это имеет ясный смысл, иногда нет. Если х = 0 находится достаточно далеко от выборочных значений х, то буквальная интерпретация может привести к неверным результатам; даже если линия регрессии довольно точно описывает значения наблюдаемой выборки, нет гарантии, что так же будет при экстраполяции влево или вправо.

Пример:

Представим простой способ интерпретации коэффициентов линейного уравнения регрессии у = a + bх, постоянная а дает прогнозируемое значение у (в единицах), если х = 0. Это может иметь или не иметь ясного смысла в зависимости от конкретной ситуации (стр. 65).

36. Как можно использовать полученные значимые оценки коэффициентов регрессии в экономическом анализе?

Можно предположить, что данный коэффициент показывает предельное изменение зависимого параметра при изменении объясняющей переменной.

37. Как модель регрессии по времени может быть использована для предсказания

значений зависимой переменной?

В модель регрессии по времени включена переменная времени и подставив нужное значение (номер периода, для которого выполняется прогноз) мы получаем прогнозное значение зависимой переменной для данного периода.

38. Каковы условия и ограничения для использования модели регрессии по времени для прогнозирования?

Должны выполняться условия Гаусса-Маркова.

I. Регрессионная модель линейна по параметрам (коэффициентам), корректно специфицирована, и содержит аддитивный случайный член.

II. Случайный член имеет нулевое среднее.

III. Объясняющая переменная не коррелирована со случайным членом.

IV. Наблюдаемые значения случайного члена не коррелированы друг с другом.

V. Случайный член имеет постоянную дисперсию

VI. Случайный член распределен нормально (необязательное, но часто используемое условие).

· Наблюдение должно включать Т+m наблюдений, из которых T – используется для построения регрессии (желательно высокое Т для точности), а последние m применяются для анализа точности предсказания. После проведения проверки можно построить прогноз на ближайшие несколько периодов, в среднем не далее 5% от длины промежутка выборки – чаще еще меньше.

39. Как можно использовать модель регрессии по факторной независимой переменной для прогнозирования?

С помощью регрессии по факторной независимой переменной можно прогнозировать поведение зависимой переменной в зависимости от изменения объясняющей переменной. Если в уравнение регрессии (с оцененными параметрами) подставить какое-то значение объясняющей переменной, то мы получим прогноз реакции зависимой переменной на изменение значения объясняющей переменной.

40. Какие проблемы и трудности возникают при использовании модели регрессии по

факторной независимой переменной для прогнозирования?

Эконометрические модели строятся из-за 2 причин. Во-первых, это прогнозирование; при высоком показателе R2 модель может дать очень хороший прогноз зависимой переменной на будущее. Во-вторых, для объяснения определенных зависимостей; в такой ситуации R2 может быть низким, но зато знак коэффициента при независимой переменной будет определен однозначно, что даст исследователю информацию о виде связи между показателями. Если модель строилась по первой причине и не имеет высокого R-квадрата, использовать ее для прогнозирования бесполезно, так как результат будет далеким от совершенства.

ТЕМА 3. Предпосылки регрессионного анализа. Условия Гаусса-Маркова

41. В чем состоят условия Гаусса-Маркова?

1. Модель линейна по параметрам (коэффициентам), правильно специфицирована, содержит аддитивный случайный член.

2. Объясняющая переменная не коррелированна со случайным членом

3. Математическое ожидание случайного члена равно нулю (E(ui)=0 для всех i)

4. Случайный член гомоскедастичен (то есть его значение в каждом наблюдении получено из распределения с постоянной теоретической дисперсией: σ2ui =σ2u для всех i)

5. Значения случайного члена имеют взаимно независимые распределения (ui распределен независимо от uj для всех j≠i).

6. Случайный член имеет нормальное распределение (необязательное, но часто используемое условие).

42. Какой вывод относительно оцениваемого уравнения регрессии можно сделать из

выполнимости условий Гаусса-Маркова?

МНК-оценка в данном случае является лучшей оценкой в классе линейных.

43. Что произойдет, если по крайней мере одно из условий Гаусса-Маркова не выполняется?

Если не выполняется 1 и 4 условие, то появляется систематическое смещение; если не выполняется 2 и 3 – оценки становятся неэффективными. В обоих случаях модель некорректна.

44. Можно ли проверить выполнение условий Гаусса-Маркова? Если да, то каким образом?

Посмотреть на показатели качества коэффициентов регрессии, а также посмотреть на показатели качества уравнения в целом. Нет интерпретации.

45. На основании чего можно судить о вероятном выполнении или невыполнении условий Гаусса-Маркова?

На основании диаграммы рассеяния, графика остатков. Важно, что случайный член (о котором теорема Гаусса-Маркова) и остатки различны, но их поведение похоже, однако случайный член не наблюдаем, зато остатки легко наблюдаемы. Поэтому мы используем остатки, чтобы судить о свойствах случайного члена.

46. Что означает, что модель линейна по параметрам?

Означает, что модель представляет собой взвешенную сумму параметров, а переменные выступают как веса, иными словами, параметры представлены непосредственно, а не как функции (например, log)

47. Можно ли оценивать методом наименьших квадратов уравнение регрессии без константы?

Нет.

48. В чем состоит роль константы уравнения регрессии?

Роль константы состоит в отражении любой систематической, но постоянной составляющей в зависимой переменной, которую не учитывают объясняющие переменные, включенные в уравнение регрессии, однако, которая оказывает влияние на исследуемую зависимую переменную. Константа интерпретируется в случае соответствия ее значения здравому смыслу или теоретическим предпосылкам.

49. К чему приводит исключение константы из линейного уравнения регрессии?

Исключение постоянного члена приводит к нарушению одного из условия Гаусса-Маркова (о равенстве нулю мат. ожидания случайного члена)

1. Оценки коэффициентов при переменных искажаются и смещаются

2. t-статистики становятся некорректными

Выводы:

1. За редкими и обоснованными исключениями не следует исключать постоянный член уравнения

2. Не следует полагаться на оценку самого свободного члена

50. В каких случаях исключение константы из уравнения регрессии оправдано?

В том случае если константа незначима в уравнении регрессии.

Исключение постоянного члена всегда должно быть обосновано содержательно экономически

Пример: Анализ затрат

Если постоянные затраты малы, то можно исключить свободный член, получив лишнюю степень свободы

Необоснованное исключение свободного члена приводит к серьезным ошибкам!

51. Что значит, что случайный член регрессии является аддитивным?

Это значит, что случайный член прибавляется к другим составляющим частям регрессии.

52. Зачем используется дополнительное условие нормальности распределения случайного члена?

Если случайный член и нормально распределен, то так же будут распределены и коэффициенты регрессии. Это условие необходимо для проводения проверки гипотез и определять доверительные интервалы для a и b, используя результаты построения регрессии.

53. Можно ли использовать уравнение регрессии, если условие нормальности распределения случайного члена не выполняется?

Если условие нормальности распределения случайного члена не выполняется, то неверно предполагать, что оценки коэффициентов регрессии имеют совместное нормальное распределение, однако при некоторых условиях регулярности на поведение объясняющих переменных в случае роста числа наблюдений оценки коэффициентов регрессии имеют асимптотически нормальное распределение. Следовательно, уравнение регрессии использовать можно (по Магнусу).

54. Какие изменения нужно внести в анализ регрессии, если известно, что предположение о нормальности распределения случайного члена регрессии не является справедливым?

Отказаться от использования тестов. Сами оценки регрессии остаются лучшими.

ТЕМА 4. Точность оценки коэффициентов регрессии. Значимость.

55. На основании каких показателей можно судить о качестве коэффициентов регрессионной модели?

- стандартные ошибки – (оценка среднего квадратичного отклонения коэффициента регрессии от его истинного значения)

- значения t-статистики (соизмеряет значение коэффициента с его стандартной ошибкой)

- вспомогательные показатели (p-value, 2-tail sig)

56. Какие из показателей качества регрессии обладают свойством сравнимости для различных моделей? При каких условиях можно сравнивать качество различных регрессионных моделей?

Стандартные ошибки и значения t-статистики.

Кроме этого сравнимы показатели SEE (стандартная ошибка регрессии) в однотипных моделях с разным числом наблюдений (и переменных).

57. В чем состоит смысл понятия «стандартная ошибка коэффициента регрессии»?

Стандартная ошибка является оценкой среднего квадратичного отклонения коэффициента регрессии от его истинного значения. Позволяет получить некоторое представление о форме функции плотности вероятности, однако не несёт информации о том, находится ли полученная оценка в середине распределения (т.е. является точной) или в его «хвосте» (т.е. является относительно неточной).

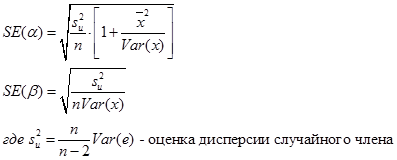

58. Какова формула для расчета стандартной ошибки коэффициента регрессии?

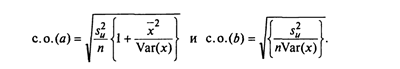

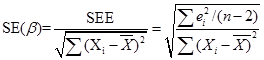

где

где

![]()

см. слайд 9,лекция 4

59. Как связаны между собой оценка дисперсии случайного члена и стандартная ошибка коэффициента регрессии?

Смотреть пункт выше: s![]() -оценка дисперсии

случайного члена, с.o. –стандартная ошибка коэффициентов a и b

регрессии (в новых лекциях SE (a)

и SE (b)).

-оценка дисперсии

случайного члена, с.o. –стандартная ошибка коэффициентов a и b

регрессии (в новых лекциях SE (a)

и SE (b)).

60. Как влияет размер выборки на точность и надежность оценивания в регрессионном анализе.

Чем больше размер выборки, тем уже и выше будет график функции плотности вероятности для х. Если п становится действительно большим, то график функции плотности вероятности будет неотличим от вертикальной прямой, соответствующей х = m. Для такой выборки случайная составляющая х становится действительно очень малой, и поэтому х обязательно будет очень близкой к m.

61. Как использовать точную математическую формулу для оценки влияния размера выборки на точность и надежность коэффициента регрессии?

62. Какое распределение имеет оценка коэффициента линейной регрессии?

Если выполняется предпосылка о нормальном распределении случайного члена, то оценка коэффициента линейной регрессии по методу наименьших квадратов имеет нормальное распределение.

63. В чем состоит смысл вычисления числа степеней свободы для анализа точного распределения оценки коэффициента регрессии?

Чтобы вычислить t-статистику и выявить максимальное число параметров, которые могут быть определены на основе имеющихся данных (из семинара 4).

64. Как рассчитывается число степеней свободы при проверке значимости коэффициента регрессии?

Оценивание каждого параметра в уравнении регрессии поглощает одну степень свободы в выборке. Отсюда число степеней свободы равняется количеству наблюдений в выборке минус количество оцениваемых параметров. Параметрами являются постоянный член (при условии, что он введен в модель регрессии) и коэффициенты при независимых переменных. В случае парной регрессии оцениваются только 2 параметра, поэтому число степеней свободы составляет п — 2.

65. Каким образом выбирается уровень значимости для проверки гипотез о коэффициенте регрессии?

В большинстве работ по экономике за критический уровень берется 5 или 1%. Если нулевая гипотеза отвергается при 1%-ном уровне значимости, то она автоматически отвергается и при 5%-ном уровне значимости. (Причем, если нулевую гипотезу можно отвергнуть при 5%-ном уровне значимости, то не нужно на этом останавливаться. Следует также выполнить тест при уровне значимости 1%. Если нулевая гипотеза может быть отвергнута и при этом уровне значимости, то это и есть нужный ответ.)

В случае же, когда нулевая гипотеза отвергается на 5%-ном, но не на 1%-ном уровне значимости, необходимо представить оба результата.

Если нулевая гипотеза не отвергается при 5%-ном уровне значимости, то это означает, что она автоматически не отвергается и при 1%-ном уровне.

66. Что подразумевается под утверждением, что оценка коэффициента регрессии является значимой?

Коэффициенты регрессии адекватны для нашей модели.

67. Какие способы существуют для определения значимости коэффициента регрессии? (подсказка: их не менее трех)

· критические значения t-статистик Стьюдента для каждого коэффициента регрессии (t-Statistic),

· p-значения (фактические вероятности принятия нулевой гипотезы) для каждого коэффициента регрессии (Prob).

Способов только два (Черняк сказал, что когда он писал вопрос, он «видимо, бредил»)!

68. Каковы практические следствия значимости коэффициента регрессии для прикладного регрессионного анализа?

Модель может быть применима в анализе.

Проверка значимости коэффициентов линейной регрессии заключается в проверке гипотезы значимости или незначимости отличия оценок некоторых регрессионных коэффициентов от нуля. Если в результате проверки оказывается, что отличие оценок каких-то регрессионных коэффициентов от нуля не влияет на качество модели, то соответствующие независимые переменные можно исключить из регрессионной модели.

69. Каковы практические следствия незначимости коэффициента регрессии для прикладного регрессионного анализа?

Возможно, переменная при этом коэффициенте действительно лишняя. Но только по критерию значимости убирать её из модели мы не можем. Главная проблема в том, чтобы понять: влияет переменная с незначимым коэффициентом на зависимую переменную, или её влияние никак не проявляется. Поэтому, если, исходя из теории или логики, переменная в модели необходима, то можно попробовать преобразовать модель или ввести новые переменные.

70. Какие практические выводы можно сделать из значимости свободного члена уравнения регрессии?

Как известно, свободный член выборочного уравнения регрессии дает оценку ожидаемого значения фактора У, при том, что фактор Х равен 0. Такая интерпретация корректна, если в выборке, по которой оценивается модель есть значения Х, близкие к нулю. В противном случае случайному члену не следует придавать содержательного толкования.

71. Какие практические выводы можно сделать из незначимости свободного члена уравнения регрессии?

Т.к. константа незначима, то ее значение можно принять равной нулю, т.е. предположить, что связь между переменными пропорциональная. В этом случае уравнение будет оцениваться маленько другими способами, но опять же с помощью МНК.

72. Коэффициент b2 в оцениваемой регрессии ![]() оказался положительным, но незначимым.

Следует ли отсюда, что коэффициент β2 в гипотетической (теоретической)

регрессии

оказался положительным, но незначимым.

Следует ли отсюда, что коэффициент β2 в гипотетической (теоретической)

регрессии ![]() также положителен? Почему?

также положителен? Почему?

Нет, не следует, так как мы получаем только оценки, а они могут быть неточными.

73. Коэффициент b2 в оцениваемой регрессии ![]() оказался положительным, и значимым. Следует

ли отсюда, что коэффициент β2 в гипотетической

(теоретической) регрессии

оказался положительным, и значимым. Следует

ли отсюда, что коэффициент β2 в гипотетической

(теоретической) регрессии ![]() также положителен?

Почему?

также положителен?

Почему?

Необязательно.

Это будет так, если в доверительный интервал (который строится относительно фактических данных) войдет только отрезок из положительных чисел.

Если же одна из границ захватит отрицательные числа, то необязательно коэффициент в теоретической регрессии также будет положительным.

74. Почему по величине коэффициента регрессии нельзя судить о силе связи двух переменных?

Нельзя судить, потому что коэффициент регрессии дает оценку отношения изменения фактора У к вызвавшему это изменение значению фактора Х, а никак не показывает силу связи между двумя переменными. Коэффициент регрессии показывает на какую величину в среднем изменяется результативный признак у при изменении факторного признака Х на единицу.

75. Почему положительный результат проверки на значимость не позволяет обосновать теоретическую модель регрессии?

Потому что это только один из аргументов. Если коэффициент значим, то это хорошая новость, но это не дает никаких гарантий. Может возникнуть много других проблем, например, коэффициент может оказаться смещен из-за пропуска существенных переменных в модели.

76. Почему t-статистики нельзя использовать для анализа данных по всей изучаемой совокупности?

По t-статистике по данным определенной выборки нельзя судить о данных по всей совокупности, она используется только для данной конкретной выборки. Только в случае, если эту выборку можно считать репрезентативной для всей совокупности, тогда t-статистику можно использовать для анализа.

77. Почему могут существовать несколько «одинаково хороших» парных регрессий

влияния разных факторов на одну и ту же зависимую переменную?

Потому что на каждую переменную в равной степени могут влиять различные факторы, все из которых учесть невозможно. В связи с этим возникает несколько «хороших» парных регрессий с «хорошими» факторами.

ТЕМА 5. Проверка гипотез о коэффициентах регрессии

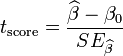

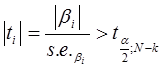

77-1. Как проверить гипотезу о нулевом значении теоретического коэффициента регрессии?

Для проверки нулевой гипотезы

H0 о равенстве нулю некоторого коэффициента регрессионного уравнения (H0:β2=0,

H0: β2≠0) необходимо

сравнить фактическое значение статистики, найденное по формуле с критическим

значением t-статистики Стьюдента для выбранного уровня значимости, то есть со

значением двусторонней (1-α) квантили t-статистики Стьюдента с n-k

степенями свободы. Величина α характеризует допустимый уровень вероятности

ошибиться, отвергнув нулевую гипотезу, когда она верна.

с критическим

значением t-статистики Стьюдента для выбранного уровня значимости, то есть со

значением двусторонней (1-α) квантили t-статистики Стьюдента с n-k

степенями свободы. Величина α характеризует допустимый уровень вероятности

ошибиться, отвергнув нулевую гипотезу, когда она верна.

Если фактическое значение t-статистики Стьюдента больше критического значения статистики, то нулевая гипотеза отвергается для данного уровня значимости α, иначе нулевая гипотеза не может быть отвергнута для данного уровня значимости α. В случае отвержения нулевой гипотезы для уровня значимости говорят, что коэффициент β регрессионного уравнения значим на уровне значимости α (или, говорят, что оценка коэффициента β значимо отличается от нуля), и соответствующий ему регрессор объясняет вариацию зависимой переменной. В противном случае говорят, что коэффициент незначим на уровне значимости α.

Второй способ проверки гипотезы – сравнить p-значение (фактическую вероятность принятия нулевой гипотезы данного коэффициента регрессии) с выбранным уровнем значимости. Если выполняется условие p< α , то нулевая гипотеза отвергается на уровне значимости α, иначе нулевая гипотеза не может быть отвергнута для данного уровня значимости α .

78. Как проверить гипотезу о нестандартном (ненулевом) значении теоретического коэффициента регрессии?

Для этого предполагаем, что Н0: β2=0. H0: β2≠0. Критической статистикой для этой гипотезы выступает t-статистика. T стат. = T критическое = t критич (n-2, ɑ)

Если |t стат|>|t критич|, то гипотеза H0 отвергается, если меньше, то подтверждается

79. Что такое p-значение (p-value, обозначаемое в программе EViews как Prob.) для

статистического критерия?

Метод p-value («метод значения вероятность») p-value = Prob – вероятность того, что случайно будет получен результат лучше, чем у нас (тот, что рассчитан). Если p-value маленький, то это хорошо, а если большой, то плохо.

80. В чем заключается техника работы с p-значением при проверке гипотез?

Смотрим значение prob. в таблице с результатами регрессии и сравниваем с 0,01 и 0,05.

Если prob < 0,01, то коэффициент (уравнение) значим на 1% уровне.

Если 0,01 < prob < 0,05, то коэффициент (уравнение) значим только на 5% уровне.

Иначе коэффициент (уравнение) не значим.

81. Как рассчитать p-значение в случае, если невозможно получить доступ к эконометрической программе, или в ней не предусмотрен его расчет?

Открываем

таблицу t-распределения, смотрим ряд для нашего числа

степеней свободы. Если в нем есть значение t-статистики

для рассматриваемого параметра, то уровень значимости (верх таблицы) будет как

раз искомым значением p. Если значение t-статистики располагается между двумя табличными, то на основе

значений для двух табличных можно приближенно рассчитать искомое по формуле ![]() , где t – значение t-статистики, t1 – первое из табличных значений, t2

– второе (большее, правее первого в ряду), а p1 и p2 – значения p соответственно для

первого и второго табличных значений t-статистики.

, где t – значение t-статистики, t1 – первое из табличных значений, t2

– второе (большее, правее первого в ряду), а p1 и p2 – значения p соответственно для

первого и второго табличных значений t-статистики.

82. Что такое ошибки первого и второго рода в проверке гипотез о коэффициентах регрессии?

Ошибка I рода состоит в том, что мы отвергаем Н0, когда на самом деле она истина.

Ошибка II рода имеет место в случае, если мы принимаем Н0, когда она ложна.

83. Какова связь ошибок первого и второго рода при проверке гипотез о коэффициентах регрессии?

При уменьшении вероятности ошибки 1ого рода увеличивается вероятность ошибки 2ого рода.

84. Что такое мощность критерия?

Мощность критерия (теста)- это вероятность допустить ошибку II рода (β), то есть принять ложную гипотезу. Вычисляется по формуле (1 − β). Таким образом, чем выше мощность, тем меньше вероятность совершить ошибку второго рода. Используя односторонний критерий вместо двустороннего, можно получить большую мощность при любом уровне значимости. Нужно, однако, помнить, что выигрыш в мощности будет получен только в условиях, когда использование одностороннего критерия оправдано.

ТЕМА 6. Доверительные интервалы для коэффициентов регрессии.

85. Как использовать метод доверительных интервалов для установления значимости коэффициента регрессии?

Если полученный коэффициент регрессии попадает в построенный доверительный интервал, то соответственно он считается значимым.

86. Как использовать метод доверительных интервалов для проверки гипотезы о

конкретном значении коэффициента регрессии (отличном от нуля)?

Нужно проверить нулевую

гипотезу (H0) о каком-то конкретном значении

коэффициента ![]() . Его возможных значений, близких к

значению эксперимента, может быть несколько. Но, начиная с какого-то момента

они будут отличаться настолько, что мы отклоним нулевую. Смысл доверительного

интервала – найти условие (интервал), в котором наше гипотетическое

. Его возможных значений, близких к

значению эксперимента, может быть несколько. Но, начиная с какого-то момента

они будут отличаться настолько, что мы отклоним нулевую. Смысл доверительного

интервала – найти условие (интервал), в котором наше гипотетическое ![]() совместимо со значением коэффициента

регрессии b

совместимо со значением коэффициента

регрессии b![]() (т.е. значение

(т.е. значение ![]() не

опровергается оценкой b

не

опровергается оценкой b![]() ).

).

Для построения интервала найдём табличные значения:

·

выберем уровень значимости (![]() ) 1%

или 5%.

) 1%

или 5%.

·

рассчитаем количество степеней свободы (n-2),

вычисляем t![]() критическое

при двустороннем интервале по таблице распределения Стьюдента.

критическое

при двустороннем интервале по таблице распределения Стьюдента.

После этого следует вычислить границы доверительного интервала следующим образом:

![]()

87. Как выбирается уровень доверительной вероятности при использовании метода

доверительных интервалов при проверке значимости коэффициента регрессии?

Зависит от того, на каком уровне значимости (1% или 5%) отвергается нулевая гипотеза Н0. Если на 1% уровне, то строим 99% доверительный интервал, если на 5%, то 95% доверительный интервал. 99% интервал будет шире, чем 95%, так как t критич будет больше для 1% ого уровня значимости.

88. В чем сходство и различие методов проверки гипотез и доверительных интервалов?

Для двусторонних тестов они эквивалентны. Односторонних интервалов просто не бывает, а односторонние гипотезы вполне работают (ответ Черняка).

ТЕМА 7. Двусторонние и односторонние тесты.

89. В чем различие между двусторонним и односторонним критериями?

При двустороннем тесте мы проверяем гипотезу H0:β=β0(в частности, β=0), используя альтернативную гипотезу H1:β≠β0.

При одностороннем тесте альтернативная гипотеза меняется на H1:β>β0 и H1:β<β0 в зависимости от того, какое влияние оказывает x на y (положительное или отрицательное соответственно). При этом у нас должны быть веские причины считать, что это влияние положительно/отрицательно.

90. В каких случаях можно использовать односторонние критерии при проверке гипотез о коэффициенте регрессии, и что это дает?

Риск одностороннего критерия в том, что он может назвать значимой переменную, которая не является значимой на самом деле. Односторонний критерий – это шанс назвать вашу переменную значимой, когда двусторонний критерий не срабатывает.

Единственное условие, при котором вы можете его применять, это если гипотеза о значимости переменной и ее важности в уравнении регрессии была построена до того, как EViews разочаровал Вас. Это вопрос этики, поскольку тесты созданы для проверки гипотезы, придумывание гипотез по результатам теста – порочный круг.

Вы протестировали регрессию, получили что важный с вашей точки зрения коэффициент не значим на двустороннем уровне, но значим по одностороннему критерию. Тогда, логически и экономически обосновывая свою позицию, что «все равно, я считаю эту переменную важной», вы присуждаете ей значимость на одностороннем критерии.

91. Каково соотношение между двусторонним и односторонним тестами? Пусть двусторонний тест позволил отвергнуть нулевую гипотезу. Что можно сказать об одностороннем тесте?

Когда имеются основания для применения одностороннего теста, его следует предпочесть двустороннему. Односторонний критерий имеет меньшую вероятность ошибки второго рода, чем соответствующий двусторонний. Поэтому, когда нет необходимости применять двусторонний критерий, применяют односторонний.

Односторонний тест – тест на проверку гипотезы, в котором область принятия гипотезы имеет только одно критическое значение, в отличие от двустороннего теста, в котором область принятия гипотезы имеет два критических значения – меньшее и большее.

Если двусторонний тест отвергнул нулевую гипотезу, то есть вероятность принятия ее односторонним.

92. Каково соотношение между двусторонним и односторонним тестами? Пусть двусторонний тест не позволил отвергнуть нулевую гипотезу. Что можно сказать об одностороннем тесте?

Если нулевая гипотеза не опровергается при двустороннем тесте, то есть шанс, что она будет отвернута при одностороннем, при условии, что нам известно направление влияния фактора.

93. Каково соотношение между двусторонним и односторонним тестами? Пусть односторонний тест позволил отвергнуть нулевую гипотезу. Что можно сказать о двустороннем тесте?

В случае, когда мы достаточно точно можем предположить направление влияния переменной, можем использовать односторонний тест. В это случае нулевая гипотеза всё та же H(0) : B=0, А альтернативная гипотеза меняется по сравнению с двусторонним тестом. Мы можем принять гипотезу

H(1): B>0 или H(1): B<0 , в зависимости от предполагаемого направления влияния. Использование одностороннего критерия облегчает отклонение нулевой гипотезы и установление зависимости.

94. Каково соотношение между двусторонним и односторонним тестами? Пусть односторонний тест не позволил отвергнуть нулевую гипотезу. Что можно сказать об двустороннем тесте?

Двусторонние тесты более строгие в отличие от односторонних. Коэффициент может быть незначим при двустороннем тесте и значим при одностороннем, поэтому использование односторонних тестов может оказаться полезным, так как хочется иметь значимые коэффициенты.

Если односторонний тест не позволил отвергнуть нулевую гипотезу, то есть значимость коэффициента обосновать не удалось, то более строгий двусторонний тест также не отвергнет нулевую гипотезу, и коэффициент является незначимым.

ТЕМА 8. F-тест для оценки уровня качества уравнения парной регрессии.

95. Для чего используется F-критерий при оценке качества уравнения регрессии?

F-тест проверяет совместную объясняющую способность всех объясняющих переменных.

Нулевая гипотеза заключается в том, что модель не обладает никакой объясняющей способностью. Если расчетная F-статистика больше табличной, то нулевая гипотеза отвергается.

96. Как рассчитать значение F-критерия, исходя из знания сумм квадратов остатков?

![]() , где ESS – сумма квадратов остатков, RSS – объясненная сумма квадратов, n – число наблюдений, k – число параметров. Если известно TSS

(общая сумма квадратов), RSS рассчитывается

с помощью формулы

, где ESS – сумма квадратов остатков, RSS – объясненная сумма квадратов, n – число наблюдений, k – число параметров. Если известно TSS

(общая сумма квадратов), RSS рассчитывается

с помощью формулы ![]() .

.

97. Как рассчитать значение F-критерия, исходя из знания коэффициента детерминации R2?

![]()

(Если F>Fкр, то отклоняет нулевая гипотеза *о незначимости*)

98. Как рассчитывается число степеней свободы для F-критерия в парной регрессии?

n-2, где n – количество наблюдений; 2 – количество оцениваемых параметров в парной регрессии.

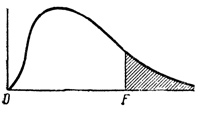

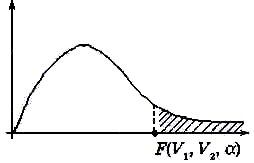

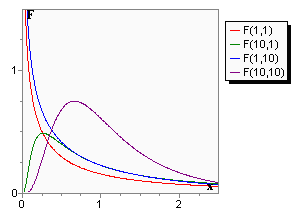

99. Каков вид F-распределения? Почему обычно используются только односторонние F-критерии?

Гипотеза Ho отвергается, если попадаем в заштрихованную область. Критерий дносторонний.

Односторонний критерий имеет более высокую мощность, чем двухсторонний критерий — при той же вероятности ошибочного отклонения нулевой гипотезы. Это говорит о предпочтительности одностороннего критерия по сравнению с двухсторонним.

100. Каков содержательный смысл отношения Фишера в определении F-критерия?

С помощью отношения Фишера мы определяем критический уровень для R2 при любом уровне значимости.

101. Каковы общие принципы выбора уровня значимости при использовании F-критерия для оценки качества уравнения в целом?

Критический уровень в 1% выше критического уровня для проверки при 5% уровне значимости. При выборе 1% уровня значимости вероятность ошибки 1 рода = 1%

102. Как использовать таблицы F-распределения при проведении F-теста?

F(а, k-1, n-k-1): а – уровень значимости. K – число объясняющих переменных с константой, n-k-1= число наблюдений – число объясняющих переменных без константы. Смотрим число, находящееся на пересечении столбца (k-1) и строки (n-k-1). F-распределение всегда одностороннее.

103. Какова связь между F-критерием и t-критерием для коэффициента регрессии? Какова связь между соответствующими критическими значениями?

Fстат.=tстат.2 Fкр.(α,n-z)=t2кр.(α, n-z, двустор.)

104. Что означает эквивалентность F-критерия и t-критерия для парной регрессии?

В парном регрессионном анализе F-критерий и t- критерий имеют одинаковые нулевые гипотезы, и эти критерии эквивалентны друг другу. Тот факт, что они эквивалентны, означает, что нет смысла выполнять оба этих теста.

105. Как проверить гипотезу о значимости коэффициента корреляции?

Коэффициент корреляции указывает на наличие (или отсутствие) линейной связи между зависимой и независимой переменной. Гипотеза о значимости коэффициента корреляции проверяется при помощи t-статистики.

Для

проверки гипотезы об отсутствии линейной связи используется тот факт, что величина

![]() имеет распределение Стьюдента с n – 2 степенями свободы.

имеет распределение Стьюдента с n – 2 степенями свободы.

t-статистики для коэффициента корреляции и для коэффициента регрессии совпадают. Проверка значимости коэффициента регрессии эквивалентна проверке наличия линейной связи.

106. Как, исходя из коэффициента детерминации, проверить гипотезу о значимости линейной связи между переменными?

Коэффициент детерминации R-squared дает предварительную оценку качества модели (от 0 до 1). Он показывает долю объясненной дисперсии зависимой переменной, эквивалентен принципу наименьших квадратов. В практике линейная связь считается значимой, если R-squared (0,6-1). Однако нужно помнить, что слишком высокий R-squared может быть тревожным сигналом (несовершенство связи, например, наличие мультиколлинеарности).. Если R-squared недостаточно высок (0-0,5), значит нужно совершенствовать и дорабатывать модель.

Коэффициент детерминации не позволяет дать окончательного заключения без учета других факторов. Он подвержен влиянию посторонних факторов и может привести к ошибочному выводу. Если отсутствуют таблицы для критических значений, на его основе нужно рассчитывать другие показатели.

107. Для чего используется показатель стандартной ошибки уравнения регрессии?

Стандартная ошибка – оценка среднего квадратического отклонения значения коэффициента от его истинного значения.

Стандартная ошибка указывается для расчета значения t-статистики вручную. Сопоставляя их следующим образом t=b/s.e.(b), мы получаем информацию о значимости регрессии: чем больше t, тем больше шансов, что он окажется значимым.

Дополнительно:

Стандартная ошибка является оценкой среднего квадратичного отклонения коэффициента регрессии от его истинного значения

Практическая формула расчета стандартной ошибки коэффициента парной регрессии:

Сравнивая значение коэффициента с его стандартной ошибкой, можно судить о значимости коэффициента.

Для стандартных ошибок нет таблиц критических уровней – для точного суждения используется t-статистика. Стандартная ошибка необходима для расчета t-критерия.

ТЕМА 9. Оценивание нелинейных моделей парной регрессии.

108. В каких случаях можно использовать метод наименьших квадратов для оценивания нелинейных моделей?

МНК можно применять к нелинейным регрессионным моделям только в том случае, если они являются нелинейными по независимым переменным или нелинейными по параметрам, но внутренне они линейны, т. е. возможна линеаризация этих моделей (замены нелинейной системы линейной) это возможно с помощью логарифмирования или обратного преобразования (инверсия)

Случайный член - мультипликативный удовлетворяет условиям Гаусса-Маркова, для функции y = αxb.

109. Какие преобразования следует выполнить для оценивания нелинейных моделей

методом наименьших квадратов?

1. Если правая часть уравнения нелинейна по переменным (линейность по переменным означает, что правая часть состоит из взвешенной суммы переменных, а параметры являются весами), то эту нелинейность можно обойти путем замены соответствующих нелинейных переменных. Например:

![]()

заменим: ![]()

тогда: ![]()

Данное преобразование является лишь косметическим и позволяет избежать лишних обозначений.

2. Если правая часть уравнения нелинейна по параметрам (линейность по параметрам означает, что правая часть состоит из взвешенной суммы параметров, а переменные являются весами), то преобразование в линейную функцию производится путём логарифмического преобразования, использую основные свойства логарифмов (в расчётах используются натуральные логарифмы):

a.

если ![]() ,то

,то ![]() ;

;

b.

если ![]() ,то

,то ![]() ;

;

c.

если ![]() ,то

,то ![]() ;

;

d.

если ![]() ,то

,то ![]() .

.

Например:

Если ![]() , то

, то ![]() .

.

Если ![]() , то

, то ![]() – полулогарифмическая модель

(логарифмически-линейная).

– полулогарифмическая модель

(логарифмически-линейная).

3. Модели типа: ![]() – не могут быть преобразованы в

уравнения линейного вида, поэтому в данном случае применение обычной процедуры

оценивания модели регрессии невозможно, но для получения оценок параметров

по-прежнему применяется принцип минимизации суммы квадратов отклонений.

– не могут быть преобразованы в

уравнения линейного вида, поэтому в данном случае применение обычной процедуры

оценивания модели регрессии невозможно, но для получения оценок параметров

по-прежнему применяется принцип минимизации суммы квадратов отклонений.

110. Какие конкретные типы нелинейных моделей пригодны для оценивания

нелинейных моделей методом наименьших квадратов?

y=α+b/x и y=αxb, т.е. модели нелинейные по переменным.

Все логарифмические зависимости могут быть оценены МНК

Функция Кобба-Дугласа может быть приведена к логарифмической зависимости:

![]()

МНК применим также для полиномиальных форм:

![]()

111. В каких случаях при оценивании нелинейных моделей метод наименьших квадратов оказывается неприменимым?

y=αxb+u. Аддитивный случайный член не дает нам прологарифмировать функцию данного вида.

112. Что делать, если модель не приводится к виду, допускающую использование

метода наименьших квадратов?

Использовать метод оценивания нелинейной регрессии Бокса-Кокса по следующему алгоритму:

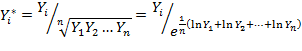

1. Преобразуем зависимую переменную по методу Зарембки

![]()

2. Рассчитываем новые переменные (преобразование Бокса-Кокса) при λ от 1 до 0.

![]()

![]()

3. Рассчитываем регрессии для новых переменных при значениях λ от 1 до 0.

![]()

4. Выбираем минимальное значение суммы квадратов остатков (SSR), выбираем одну из крайних регрессий, к которой ближе точка минимума

ТЕМА 10. Интерпретация и использование нелинейных моделей парной регрессии.

113. Для чего нужны нелинейные эконометрические модели?

Нелинейные соотношения гораздо лучше подходят для описания многих экономических процессов, чем линейные.

Пример:

1. Анализ роста

Теоретический феномен – экономический рост

Анализ предпосылок: прирост пропорционален накопленному потенциалу

Формализация предпосылок:

![]()

Интерпретация и анализ: коэффициент регрессии «бета» - годовой темп роста, возможно сопоставление с реальными данными

2. описание кривых Энгеля, характеризующих соотношение между спросом на определённый товар Y и общей суммой дохода Х (подробное описание в 3-ем издании учебника Доугерти, стр.162-164).

114. Исходя из каких соображений и в каком порядке следует выбирать форму зависимости для эконометрической модели?

Из соображений графического соответствия, расчета эластичности и угла наклона, а также по тем соображениям, какая задача стоит перед нашей моделью и по теоретическим соответствиям о природе тех или иных зависимостей.

Выбираем из:

1. Линейные зависимости – самые простые зависисмости, всегда оставляем ее, если нет логического подтверждения необходимости иной спецификации.

2. Логарифмические зависимости – В зависимости от значений коэффициентов регрессии

Логарифмические зависимости отображают большое разнообразие форм, логарифмические зависимости помогают уменьшить масштаб переменных для их сравнимости.

3. Полулогарифмические зависимости – В зависимости от значений коэффициентов регрессии полулогарифмические зависимости отображают большое разнообразие форм с эффектом насыщения

4. Полиноминальные зависимости - Эти функции хорошо подходят для моделирования эффекта масштаба, анализа максимумов и минимумов

5. Обратные зависимости – Эти функции хорошо подходят для моделирования эффектов полного насыщения и ограниченности

115. Как интерпретируется коэффициент линейной формы регрессионной модели? Как можно обосновать справедливость предложенной интерпретации?

Линейная форма: ![]()

Интерпретация коэффициентов регрессии – предельный эффект независимого фактора.

![]()

Для полученных оценок уравнения регрессии

![]()

![]()

![]()

![]()

![]()

Т.е коэффициент регрессии показывает прирост результирующей переменной при изменении независимого фактора на единицу

116. В каких случаях оправдано использование линейной регрессии?

1. Если в этом есть экономический смысл

2. Если модель получилась формально качественной

Другой ответ:

В случае, когда необходимо рассчитать линейную связь между зависимой и независимой переменной, а затем использовать эту связь при прогнозировании, то есть используется для прогнозирования будущих значений параметра у исходя из имеющихся данных.

117. Как вычислить эластичности в каждой точке в случае использования линейной регрессии, и для чего можно использовать этот показатель?

E=(Δy/Δx)*x/y=bx/y. Для исследования того, является ли функция y=αxb приемлемой.

118. Как интерпретируется коэффициент дважды логарифмической формы регрессионной модели? Как можно обосновать справедливость предложенной интерпретации?

![]() =>

=> ![]() Коэффициент

интерпретируется следующим образом: эластичность Y по Х

постоянна и равна

Коэффициент

интерпретируется следующим образом: эластичность Y по Х

постоянна и равна ![]() .

.

На сколько % изменится y при изменении x на 1 %. dy/y=b*dx/x => b=(dy/dx)*x/y

119. В каких случаях оправдано использование двойной логарифмической формы регрессии?

Используем там, где есть основание. Предполагаем постоянство эластичности. y’=α’xibu’ => lny= lnα+blnxi+u

120. Как рассчитать предельный эффект фактора в каждой точке в дважды логарифмической регрессионной зависимости?

Вычисление коэффициента наклона (скорости роста фактора), (dy/dx)=b*x/y

121. Каких видов существуют полулогарифмические регрессии?

1) линейно-логарифмические (![]() )

)

2) логарифмически-линейные (![]() )

)

122. Как интерпретируется коэффициент линейно-логарифмической формы регрессионной модели? Как можно обосновать справедливость предложенной интерпретации?

y= α+bx+u, dy=bdx/x => b=(dy/dx)*x. при интерпретации делим на b/100. На сколько возрастет y при росте x на 1%

123. В каких случаях оправдано использование линейно-логарифмической формы регрессии?

Там, где эластичность убывает с ростом y.

Линейно-логарифмические модели обычно используются в тех случаях, когда необходимо исследовать влияние процентного изменения независимой переменной на абсолютное изменение зависимой переменной.

124. Как рассчитать и использовать эластичность при использовании линейно-логарифмической формы регрессионной модели?

Пусть

эластичность постоянна: ![]()

![]()

Коэффициент регрессии при переменной log X выражает эластичность зависимой переменной у по переменной X при условии постоянства других переменных.

125. Как интерпретируется коэффициент логарифмически-линейной формы регрессионной модели? Как можно обосновать справедливость предложенной интерпретации?

lny=lnα+blnxi+u. На сколько процентов (x/100) возрастет y при изменении x на единицу. dy/y=bdx => b=dy/dx*y. b*100

126. В каких случаях оправдано использование логарифмически-линейной формы регрессии?

Если зависимость между у и х задана в нелинейной форме, например у=αхb,т.е. когда речь идет о степенных функциях. Эластичность растет с ростом x

127. Как рассчитать и использовать эластичность при использовании логарифмически-линейной формы зависимости?

Аналогичен следующему.

128. Как рассчитать и использовать эластичность при использовании логарифмически-линейной формы зависимости?

Для логарифмически-линейной функции вида

![]()

эластичность рассчитывается по формуле

![]()

Ее можно использовать для отображения величины реакции изменения зависимого параметра от независимого.

129. Как используется логарифмически-линейной формы регрессии по времени? Какова интерпретация коэффициента регрессии?

Имеем показательную функцию вида y=αert. logy=logα+rt. оценивая регрессию между logy и t мы получаем оценку темпа прироста r. Обычно речь идет о процентных темпах прироста. Постоянный множитель α интерпретируется след. образом: «прогнозируется», что в момент t=0 величина y составит α ед. А темп прироста y составит r*100% в год. Удобен для построения моделей экономического роста.

130. Как интерпретируется обратно пропорциональная регрессионная зависимость модели? Как можно обосновать справедливость предложенной интерпретации?

![]()

С ростом X зависимая переменная приближается к некоторому числу (моделирование эффекта насыщения).

131. В каких случаях оправдано использование обратно пропорциональной регрессионной зависимости?

Если с ростом x зависимая переменная приближается к какому-то числу.

132. Как рассчитать и использовать эластичности для обратно пропорциональной регрессионной зависимости?

![]()

При возрастании x на 1%, y снизится на столько процентов (b*(1/xy)). Т.к. эластичность напрямую зависит от переменной x, то можно посчитать значение эластичности для каждого x (или для нужного х), а чаще всего берется среднее х.

ТЕМА 11. Сравнение нелинейных регрессионных моделей.

133. При сравнении каких моделей нужно использовать преобразование Зарембки?

При

выборе между линейной и лог линейной моделью, делается преобразование Зарембки

зависимой переменной, строятся модели для этой преобразованной переменной, а потом

сравниваются суммы квадратов остатков, отношение которых имеет распределение ![]() .

.

134. Что дает использование преобразования Зарембки?

Оценку значимости наблюдаемых различий. Можем выявить, какая из моделей является более качественной.

135. В чем состоит идея метода Зарембки?

Метод Зарембки применяется для выбора из двух форм моделей (несравнимых непосредственно), в одной из которых зависимая переменная входит с логарифмом, а в другой – нет. Данный метод позволяет сравнить линейную и логарифмическую регрессии и оценить значимость наблюдаемых различий. Эти регрессии непосредственно несравнимы, так как логарифмы на много порядков меньше самих чисел. Чтобы сделать их сравнимыми, нужно выполнить специальное преобразование (преобразование Зарембки).

1. Вычисляем среднее геометрическое значений

зависимой переменной и все ее значения делятся на это среднее:

2. Рассчитываются линейная и логарифмическая

регрессии и сравниваются значения их суммы квадратов остатков (SSR): ![]()

![]()

3. Вычисляем χ2-статистику для оценки

значимости различий: ![]()

4. Сравниваем с критическим значением χ2-распределения с одной степенью свободы, различия значимы, если χ2> χ2крит.

В Eviews:

1.Genr logY=log(Y)

2.Genr Ys=Y/exp(@mean(logY))

3.ls Ys c Х

4.Сравним полученные значения SSR.

Лучшей считается модель, в которой значения SSR меньше.

136. При сравнении каких моделей метод Зарембки применять не нужно?

Метод Зарембки применим для выбора из двух форм моделей (несравнимых непосредственно), в одной из которых зависимая переменная входит с логарифмом, а в другой - нет. Метод позволяет сравнить линейную и логарифмическую регрессии и оценить значимость наблюдаемых различий.

Не нужно применять данный метод для уравнений одной функциональной формы, а так же для сравнения между собой иных форм, кроме линейной и логарифмической (двойная-логарифмическая; линейно-логарифмическая; обратная).

137. Как формулируется нулевая гипотеза при проведении теста Бокса-Кока для

сравнения двух моделей?

Суммы квадратов остатков двух сравниваемых моделей равны.

138. Как проводится тест Бокса-Кокса для сравнения качества двух моделей?

Тест Бокса-Кокса состоит в преобразовании масштаба наблюдений переменной Y , для обеспечения возможности сравнения RSS линейной и логарифмических моделей.

1) Вычисляется среднее геометрическое значение Y в выборке. Оно совпадает с экспонентой среднего арифметического log Y, которое легко рассчитать

![]() =

= ![]()

2) Теперь пересчитываются значения Y, они делятся на среднее геометрическое Y

![]()

3)

Оцениваются регрессии как в линейной, так и в логарифмической модели с

использованием ![]() вместо Y и

log

вместо Y и

log ![]() вместо

logy

вместо

logy

Таким образом, теперь можно сравнивать сумму квадратов остатков(RSS).

Чем сумма меньше, тем модель лучше

139. На основании чего проводится выбор модели, если тест Бокса-Кокса указывает на необходимость отвергнуть нулевую гипотезу?

Выбор модели проводится на основании минимального значения суммы квадратов остатков при разных значениях лямбда, и выбирается одна из крайних регрессий, к которой ближе находится эта точка минимума.

140. На основании чего проводится выбор модели, если тест Бокса-Кокса указывает на невозможность отвергнуть нулевую гипотезу?

Если тест Бокса-Кокса указывает на невозможность отвергнуть нулевую гипотезу , то выбор модели производится на основе экономических соображений и сравнении других показателей модели (например, R²).

ТЕМА 12. Интерпретация и использование моделей множественной линейной регрессии.

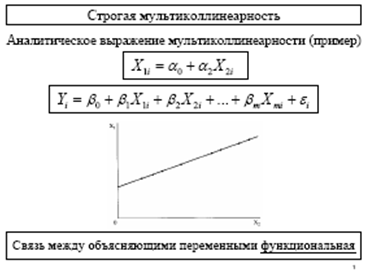

141. В чем особенность интерпретации коэффициентов регрессии в случае нескольких независимых переменных?

При множественном регрессионном анализе существенен вопрос разграничения эффекта влияния данной независимой переменной на зависимую от воздействия других независимых переменных. Другая проблема заключается в оценке объективной объясняющей способности независимых переменных в противоположность их отдельным предельным эффектам.

142. Какова интерпретация коэффициентов множественной линейной регрессии?

Классическая

линейная регрессия имеет вид ![]()

Интерпретация регрессии: коэффициент регрессии при переменной X1 выражает предельный прирост зависимой переменной при изменении переменной X1 и при условии постоянства других переменных. То есть:

![]()

143. Какова интерпретация коэффициентов множественной логарифмической регрессии (логарифмы при всех переменных)?

Y i = α + β1 logX1i + β2 logX2i + + ui

Коэффициент регрессии при переменной X1 выражает предельный прирост зависимой переменной при изменении переменной X1, при условии постоянства других переменных.

144. Какова интерпретация коэффициентов множественной логарифмической регрессии, включающей время (логарифмы при всех переменных, кроме времени)?

logY i =α+β1logX1i +β2logX2i + β3t +ui

Интерпретация коэффициентов множественной логарифмической регрессии: коэффициент регрессии при переменной logX1 выражает эластичность зависимой переменной по переменной X1 в момент времени t, при условии постоянства других переменных.

145. В чем особенность расчетных формул для коэффициентов множественной линейной регрессии? Какие дополнительные факторы они учитывают?

Значение коэффициента регрессии дополнительно учитывает не только связи изучаемого фактора с зависимой переменной, но и структуру связей между независимыми переменными.

146. Какова структура связей в уравнении множественной регрессии и каким образом ее следует учитывать при анализе уравнения?

В множественной регрессии есть переменные которые непосредственно влияют на зависимую переменную – то есть включены в модель. и те, которые влияют опосредованно, так как напрямую в модель не включены. это стоит учитывать, так как при невключении важной переменной, оставшиеся переменные в модели будут отражать вклад этой переменной, что может привести к смещению оценок коэффициентов и нерепрезентативности индикаторов качества регрессии в целом (t, F статистик).

при невозможности включить важную переменную, нужно включить максимально коррелированную с ней замещающую переменную.

147. Можно ли сравнивать коэффициенты регрессии по их величине и использовать это сравнение для оценка значимости вклада каждой из переменной?

Значение коэффициентов в множественной регрессии показывает предельный вклад каждой переменной в объяснение дисперсии значений зависимой переменной. Однако напрямую сравнивать их нельзя – надо учитывать единицы измерения и различные содержательные вопросы. Так например, в упражнении 1 семинара 6 нельзя напрямую сравнивать коэффициенты регрессии – надо учитывать трудоемкость. Иначе говоря, надо учитывать дополнительные содержательные факторы, и тогда сравнивать можно.

ТЕМА 13. Качество уравнения множественной регрессии.

148. Какими свойствами обладают оценки коэффициентов регрессии, полученные методом наименьших квадратов в случае выполнимости условий теоремы Гаусса-Маркова?

Оценки коэффициентов при использовании МНК и при соблюдении условий теоремы Гаусса-Маркова будут наиболее эффективными, линейными (комбинациями Y) и несмещенными.

149. Каковы последствия для свойств оценок коэффициентов регрессии, полученных

методом наименьших квадратов, в случае невыполнения условий теоремы Гаусса-

Маркова?

Если не выполняется второе условие Мат ожидание остатков ![]() , то оценка коэффициентов для парной

регрессии будет смещена, неэффективна и несостоятельна.

, то оценка коэффициентов для парной

регрессии будет смещена, неэффективна и несостоятельна.

Если не выполняется пятое условие, ![]() ,

то появляется гетероскедастичность и оценка будет несмещенной, но

неэффективной, но может быть состоятельной.

,

то появляется гетероскедастичность и оценка будет несмещенной, но

неэффективной, но может быть состоятельной.

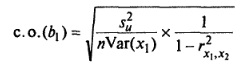

150. Какие факторы дополнительно учитывает формула для расчета стандартной ошибки в случае множественной регрессии, по сравнению с аналогичной формулой для парной регрессии?

В случае множественной регрессии формула с.о. учитывает еще коэффициент корреляции между независимыми переменными. Если коэффициент корреляции близок к единице, т.е. существует тесная связь между переменными, то с.о. будет большой, что отражает вероятную неточность коэффициентов регрессии.

151. Каковы показатели качества уравнения регрессии в целом?

Показатели качества коэффициентов регрессии:

· Стандартные ошибки коэффициентов

· Значения t-статистик

· Вспомогательные показатели (p-value, ...)

Показатели качества уравнения в целом

· R2

· Скорректированный R2

· Значения F-статистики

· Сумма квадратов остатков (RSS)

· Стандартная ошибка регрессии (SEE)

152. Для чего используется показатель стандартной ошибки уравнения регрессии?

Стандартная ошибка дает общее представление о степени точности коэффициента регрессии, используется при расчете t-статистики и значений p для параметра.

153. Как рассчитывается показатель стандартной ошибки уравнения регрессии?

![]() для случая парной регрессии , где

для случая парной регрессии , где ![]() - выборочная дисперсия остатков

- выборочная дисперсия остатков

Если у нас регрессия с 2мя независимыми переменными, то используем

![]()

154. Какова связь показателей качества коэффициентов регрессии и показателей качества уравнения в целом в случае множественной регрессии?

В случае множественной регрессии t-тест и F-тест выполняют разные функции: t-тесты проверяют значимость коэффициента при каждой переменной по отдельности, в то время как F-тест проверяет их совместную объясняющую способность.

Вообще говоря, F-статистика будет значимой, если значима по крайней мере одна из t-статистик. Однако в принципе F-статистика может и не быть значимой в этом случае. Пример: Предположим, что вы оценили не имеющую смысла регрессию с 40 объясняющими переменными, каждая из которых не является действительным детерминантом зависимой переменной. В этом случае F-статистика должна оказаться достаточно низкой, чтобы гипотеза Н0 не была отвергнута. Однако если выполнить t-тесты для коэффициентов наклона на 5%-ном уровне, то в среднем можно ожидать, что 2 из 40 переменных будут иметь «значимые» коэффициенты.

В то же время может получиться, что F-статистика будет значимой при незначимости всех t-статистик. Пример: предположим, у вас имеется модель множественной регрессии, которая правильно специфицирована, и коэффициент детерминации высокий. Вероятно, что в этом случае F-статистика высоко значима. Однако если объясняющие переменные сильно коррелированны и модель подвержена сильной мультиколлинеарности, то стандартные ошибки коэффициентов наклона могут оказаться столь велики, что ни одна из t-статистик не будет значима.

155. Каковы особенности анализа коэффициента детерминации в случае множественной регрессии?

Как и в парном регрессионном

анализе, коэффициент детерминации R2 определяет долю

дисперсии у, объясненную регрессией, и эквивалентно определяется как

величина![]() . Этот коэффициент никогда не уменьшается (а

обычно он увеличивается) при добавлении еще одной переменной в уравнение

регрессии, если все ранее включенные объясняющие переменные сохраняются. Если

новая переменная на самом деле не относится к уравнению, то увеличение

коэффициента R2 будет, вероятно, незначительным.

. Этот коэффициент никогда не уменьшается (а

обычно он увеличивается) при добавлении еще одной переменной в уравнение

регрессии, если все ранее включенные объясняющие переменные сохраняются. Если

новая переменная на самом деле не относится к уравнению, то увеличение

коэффициента R2 будет, вероятно, незначительным.

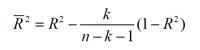

Скорректированный коэффициент R2,

который обычно обозначают ![]() , обеспечивает компенсацию для такого

автоматического сдвига вверх путем наложения «штрафа» за увеличение числа

независимых переменных. Этот коэффициент определяется следующим образом:

, обеспечивает компенсацию для такого

автоматического сдвига вверх путем наложения «штрафа» за увеличение числа

независимых переменных. Этот коэффициент определяется следующим образом: , где k — число независимых переменных. По мере роста k увеличивается отношение k/(п — k— 1) и,

следовательно, возрастает размер корректировки коэффициента R2 в

сторону уменьшения.

, где k — число независимых переменных. По мере роста k увеличивается отношение k/(п — k— 1) и,

следовательно, возрастает размер корректировки коэффициента R2 в

сторону уменьшения.

Можно показать, что добавление новой переменной к регрессии приведет к увеличению R2, если и только если соответствующая r-статистика больше единицы (или меньше —1). Следовательно, увеличение R2 при добавлении новой переменной необязательно означает, что ее коэффициент значимо отличается от нуля. Поэтому отнюдь не следует, как можно было бы предположить, что увеличение R2 означает улучшение спецификации уравнения.

156. Для чего используется скорректированный коэффициент детерминации?

Для наложения «штрафа» за увеличение числа объясняющих переменных, так

как обычный ![]() при увеличении числа переменных всегда

растет.

при увеличении числа переменных всегда

растет.

157. Как рассчитывается скорректированный коэффициент детерминации и какие факторы определяют его значение?

![]() , где

, где

k-1 – число объясняющих переменных.

Как и обычный ![]() , скорректированный зависит от

«объяснённой» суммы квадратов отклонений от выборочного среднего (ESS) и остаточной суммы квадратов (TSS),

т.е. от

, скорректированный зависит от

«объяснённой» суммы квадратов отклонений от выборочного среднего (ESS) и остаточной суммы квадратов (TSS),

т.е. от ![]() ,

, ![]() , Y. Но, в отличие от

, Y. Но, в отличие от ![]() , adjusted

, adjusted ![]() не увеличивается

при добавлении любых объясняющих переменных. Adjusted

не увеличивается

при добавлении любых объясняющих переменных. Adjusted ![]() увеличится только если соотвестсвующая добавленной переменной t-статистика

больше 1 или меньше -1.

увеличится только если соотвестсвующая добавленной переменной t-статистика

больше 1 или меньше -1.

ТЕМА 14. Тесты на значимость уравнения множественной регрессии и его коэффициентов.

158. На основании каких показателей можно судить о качестве регрессионной модели в целом?

При проверке качества модели в первую очередь стоит обращать внимание на то, соответствует ли она логике экономического процесса, т.е. мы должны смотреть, реалистичны ли знаки коэффициентов перед независимыми переменными и реалистична ли их величина.

Традиционно качество регрессии оценивается с

помощью: ![]() , t-статистики

и F-статистики.

, t-статистики

и F-статистики.

Далее – подробный ответ. В принципе, не нужен – как и говорил Черняк. Однако может пригодиться в подготовке, решайте сами. «Ненужное» выделил серым.

R2 (коэффициент детерминации):

Коэффициент детерминации показывает объясняющую способность регрессии.

Формула ![]() =

=  , где

, где

![]() -расчётное (оно же теоретическое и предсказанное) значение

-расчётное (оно же теоретическое и предсказанное) значение

![]() - выборочное среднее.

- выборочное среднее.

Чем выше ![]() ,

тем больше построенная нами линия регрессии соответствует всем наблюдениям.

Поэтому если мы хотим по регрессии строить предсказания (т.е. подставлять значения

независимых переменных и получать точную, правдивую оценку зависимой), нам

необходим высокий

,

тем больше построенная нами линия регрессии соответствует всем наблюдениям.

Поэтому если мы хотим по регрессии строить предсказания (т.е. подставлять значения

независимых переменных и получать точную, правдивую оценку зависимой), нам

необходим высокий ![]() .

.

t-статистика:

t-статистика соизмеряет значение коэффициента с его стандартной ошибкой. Фактически же мы проверяем гипотезу о том, равен нулю коэффициент при рассматриваемой переменной или нет. Т.е:

Ho: коэффициент=0. Если эта гипотеза верна, то коэффициент не значим.

Ha: коэффициент не равен 0. Если эта гипотеза верна, то коэффициент значим.

Выяснить, отвергается нулевая гипотеза или нет, можно 2 способами:

1. Метод критических значений (по таблицам):

a) Находим фактическое значение t (Черняк не говорил формулу, так что она м.б. и не нужна):